什么是GAS框架?

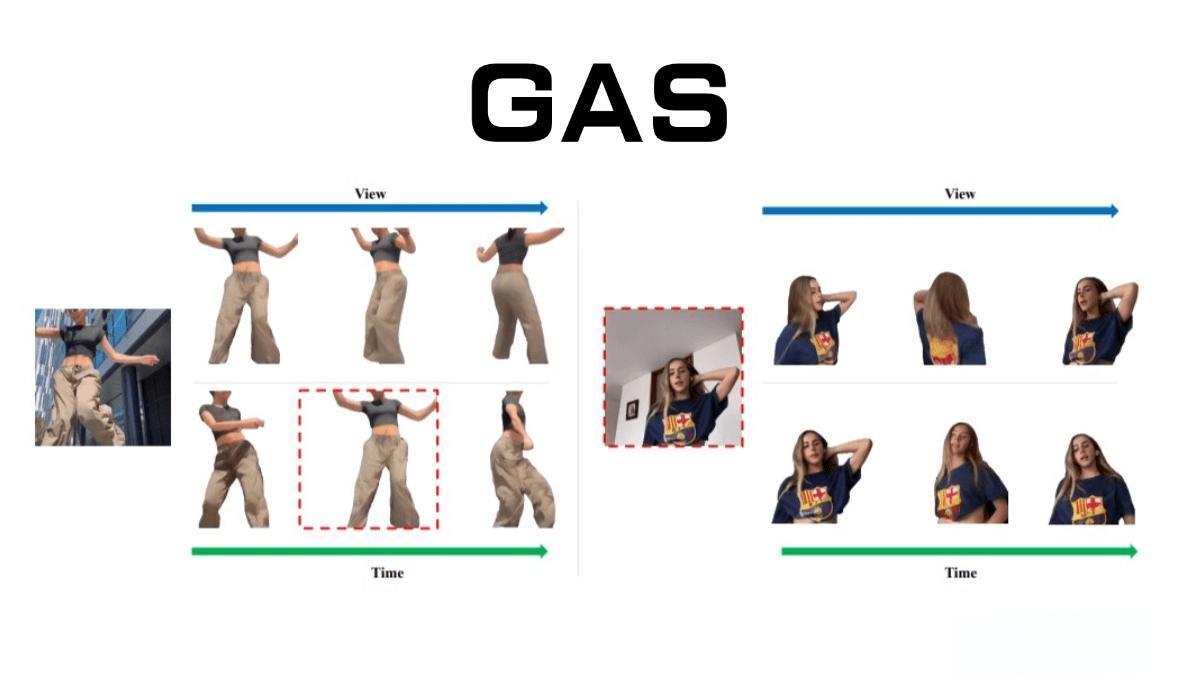

GAS(Generative Avatar Synthesis from a Single Image)是一项由卡内基梅隆大学、上海人工智能实验室和斯坦福大学的研究人员共同开发的前沿技术。该框架能够从单张图像生成高质量、视角一致且时间连贯的虚拟形象。通过结合回归型3D人体重建模型和扩散模型的优势,GAS在虚拟形象生成领域取得了显著突破。

GAS的核心在于其独特的“模式切换器”模块,能够区分视角合成和姿态合成任务,从而提升生成效果的准确性和真实性。这一技术不仅为虚拟形象的生成提供了新的可能性,还为多个行业带来了革命性的变化。

GAS的核心功能

-

视角一致的多视角合成 GAS可以从单张图像生成高质量的多视角渲染,确保不同视角下的外观和结构一致性。这对于需要多角度展示的应用场景(如虚拟试衣、游戏建模)尤为重要。

-

时间连贯的动态姿态动画 通过给定的姿态序列,GAS能够生成流畅且真实的非刚性形变动画。这一功能在影视特效、虚拟现实(VR)和体育训练等领域具有广阔的应用前景。

-

统一框架与泛化能力 GAS将视角合成和姿态合成任务统一在一个框架内,通过共享模型参数和利用大规模真实数据(如网络视频)进行训练,显著提升了模型的泛化能力。

-

密集外观提示 基于3D重建模型生成的密集信息作为条件输入,GAS确保了生成结果在外观和结构上的高保真度。

GAS的技术原理

-

3D人体重建与密集条件信号 GAS首先基于回归型3D人体重建模型(如单视角通用人类NeRF)从输入图像生成中间视角或姿态。通过将输入图像映射到规范空间并重新定位,生成密集的外观提示。这些信息为后续的扩散模型提供了丰富的细节和结构信息。

-

视频扩散模型与统一框架 生成的中间视角或姿态被用作视频扩散模型的条件输入,通过扩散模型生成高质量的视角一致性和时间连贯性动画。GAS的统一框架实现了从姿态合成到视角合成的自然泛化。

-

模式切换器 为了区分视角合成和姿态合成任务,GAS引入了模式切换器模块。该模块支持网络在生成视角时专注于一致性,在生成姿态时专注于真实感变形。

-

真实世界数据的泛化能力 GAS通过结合大规模真实世界视频(如网络视频)进行训练,显著提升了对真实场景的适应能力。多样化的数据来源使得模型能够适应各种光照、服装和动作条件。

-

训练与推理 GAS的训练分为两个阶段:首先训练3D人体重建模型,然后冻结该模型并训练视频扩散模型。推理时,根据任务性质(视角合成或姿态合成)采用不同的分类器自由引导(CFG)策略。

GAS的应用场景

-

游戏和虚拟现实(VR) GAS可以从单张图像生成高质量的虚拟形象,支持多视角和动态姿态的连贯合成,为游戏开发和VR体验提供全新的可能性。

-

影视制作 在影视特效和动画制作中,GAS能够快速生成逼真的虚拟角色,显著减少传统建模和动画制作的时间和成本。

-

体育和健身 通过从单张图像生成动态虚拟形象,GAS可用于创建个性化的运动动画,帮助运动员分析动作或用于健身应用中。

-

时尚和服装设计 GAS能够生成不同姿态和视角的虚拟形象,帮助设计师快速预览服装效果,提升设计效率。

GAS的项目资源

-

项目官网:GAS官方页面

-

技术论文:GAS的arXiv论文

结语

GAS框架代表了AI技术在虚拟形象生成领域的最新进展,其强大的视角一致性和时间连贯性生成能力为多个行业带来了全新的可能性。无论是游戏开发、影视制作,还是体育训练和服装设计,GAS都展现出了巨大的应用价值。随着技术的不断进步,GAS有望在未来推动更多创新应用的实现。